Czy ludzkość przełoży kiedyś stosy ksiąg i dokumentów zalegających w piwnicach na zapis cyfrowy?

Obawiam się, że prędko spod tych papierów się nie wygrzebiemy. Trudno sobie wyobrazić ogólnoświatowy albo chociaż ogólnopolski system, który miałby zgromadzić wszelką dokumentację papierową. Musimy liczyć na działania oddolne i takie inicjatywy już powstają. Jeśli miłośnicy jakiegoś regionu postanawiają zdigitalizować jego zasoby i udostępnić je w sieci, nie zostają z tym sami. Różne uczelnie, m.in. Politechnika Warszawska, mogą przekazać im technologie i know-how.

Ale takie cyfrowe pospolite ruszenie ma chyba wady? co się stanie, jeśli przetworzone zostaną wszystkie księgi parafialne? czy udostępnienie ich całemu światu nie łamie ustawy o ochronie danych osobowych? nasze prawo nadąża za procesem cyfryzacji?

Oczywiście, że nie nadąża. Właścicielem zawartych w księgach parafialnych danych jest Kościół katolicki. Jeśli chce je zdigitalizować tak, że możliwe będzie ich udostępnienie, to znaczenie mogą mieć zapisy ustawy o ochronie danych osobowych. Ale jak tu uzyskać zgodę osób figurujących w księgach parafialnych? Rozwiązanie problemu wymaga zmiany prawa.

To może nie warto w ogóle tych ksiąg digitalizować?

Ależ warto! Cyfryzacja takich danych może nam dać duże zyski cywilizacyjne, m.in. ułatwi tworzenie drzew genealogicznych.

co będę miała z tego, że mój sąsiad pozna swój rodowód?

Chodzi o znajomość prawdy historycznej, dziedziczenia – czyli spraw majątkowych, rozwoju społeczności lokalnych.

Czy w polsce kogoś interesuje los starych danych naukowych, np. meteorologicznych, które leżą w piwnicach instytutów?

Największe ośrodki radzą sobie z tym problemem, gorzej z tymi mniejszymi. Nie wiemy, ile zasobów gnije w bibliotekach. To niedobrze, ale powiedzmy, że można to zrozumieć. Większym problemem jest brak publicznego dostępu poprzez internet do archiwów danych, które są tworzone na bieżąco.

Co robi się z informacjami w archiwach cyfrowych? czy można w nich zastosować tzw. eksplorację danych?

Eksploracja danych, z angielska data mining, to raczej metoda analizy danych handlowych czy finansowych, a nie dzieł literackich czy ksiąg parafialnych. Data mining zaczęły prowadzić w latach 90. supermarkety do analizy zachowań klientów. Okazało się np., że jeśli mężczyzna wchodzi do sklepu i kupuje pieluszki dla dziecka, to prawdopodobnie kupi też piwo. To korelacja odkryta metodami automatycznymi. Wcześniej nikt nie miał o niej pojęcia. Potem ustalono jej przyczynę: mężczyźni żeby usprawiedliwić przed żoną zakup piwa, wrzucają też do koszyka pieluszki.

Czy podobne badania robi się też na tekstach?

Tak zwany text mining, eksplorację tekstu, stosują choćby dostawcy darmowych kont e-mailowych. Posiadacze tych kont dostają reklamy tematycznie związane z ich zainteresowaniami.

A jak to się ma do archiwizacji?

Bezpośrednio nie ma się wcale. Ale musimy odpowiedzieć sobie na pytanie, po co tworzymy archiwa cyfrowe. Czy tylko po to, by dokumenty przechowywać dla potomności? Repozytoria umożliwiają przecież ciekawe badania literaturoznawcze. Mając zbiór wszystkich dzieł autorów polskich, możemy odkryć, że ktoś, kto pisał pod pseudonimem, tworzył poezję taką samą jak Cyprian Kamil Norwid. I być może to jest ta sama osoba. Jednak żeby móc tak analizować, najpierw te archiwa zróbmy.

Czyli priorytetem archiwum cyfrowego jest zachowanie dokumentów przed zniszczeniem i ułatwienie dostępu do nich?

To ostatnie jest najważniejsze. Z czego zresztą często nie zdają sobie sprawy osoby, które powinny na to łożyć pieniądze. Podstawową różnicą między archiwum klasycznym a cyfrowym jest właśnie dostęp do wiedzy. I to z dowolnego miejsca globu.

W taki sposób współpracuje już wielu naukowców. udostępniają sobie wyniki badań np. w sieci GeneWiki. Dzieląc się danymi, działają szybciej i nie muszą wyważać otwartych drzwi.

W nauce widać dwa trendy. Pierwszy, jak sądzę zamierający, zakłada, że naukowcy pracują po to, by badania opublikować w płatnym czasopiśmie, opatentować i skomercjalizować pod własnym nazwiskiem. Drugi trend, rosnący w siłę szczególnie w dyscyplinach ścisłych, promuje naukę otwartą. Badania prowadzone są wtedy wspólnie przez różne ośrodki badawcze i nie można wskazać jednego autora sukcesu.

Co ciekawe, rozwija się on w genetyce przy pracach nad nowymi lekami i w informatyce, choć gra toczy się tam o wielkie pieniądze.

Większość badań w tych dziedzinach wymaga tak znacznych zasobów finansowych i ludzkich, że mało które jednostki potrafią je udźwignąć. Naukowcy coraz częściej przyjmują do wiadomości, że ich publikacja ma szanse zaistnienia tylko wtedy, gdy pojawi się w bezpłatnym i dostępnym dla wszystkich periodyku.

Na ich rzecz rezygnują z prestiżowych czasopism jak Nature i Science? Jak ocenić jakość i znaczenie tych badań bez gradacji, którą gwarantuje zespół recenzentów dobrego czasopisma?

Ten model oceny coraz częściej jest kwestionowany, bo zdarza się, że nawet najlepszy zespół ekspertów zostaje wyprowadzony w pole. W związku z tym powstają darmowe czasopisma internetowe, tzw. Open Access, takie jak choćby PLoS ONE. Działa jak forum dla naukowców. Każda praca jest tam przedmiotem dyskusji natychmiast po tym, gdy zostanie upubliczniona przez autora.

Wróćmy do typowych problemów archiwizacji. cyfrowe dane trzeba co kilka lat przenosić na coraz nowsze nośniki, w ślad za zmianami technologii. Dziś mało kto ma czytnik dyskietek 3,5-calowych tak popularnych 10 lat temu. Jeśli archiwista takiej dyskietki z jakiegoś powodu nie przepisze, dane przepadną?

Tak samo można spalić książkę.

No tak, ale książki mają duży nakład, zawsze jakaś się ostanie.

Na szczęście nie mamy jednej globalnej biblioteki cyfrowej, która zbiera całą wiedzę ludzkości, więc materiały znajdują się w różnych miejscach w wielu kopiach. Jednak przygotowując archiwum, nie możemy polegać na obcych zasobach. Świętym założeniem nowoczesnego bibliotekarza jest tworzenie tzw. archiwów wieczystych. Należy zastosować takie technologie, które uniemożliwią skasowanie raz zapisanych informacji. Powinniśmy też mieć w razie jakiejś gigantycznej awarii stworzone duplikaty wszystkich danych. Najlepiej przechowywane w bunkrach albo, jak to zrobili Finowie, schowane w wydrążonej w skale jaskini. Jest jeszcze kwestia formatu, w jakim to przechowujemy. Czy komputery, które będą produkowane na przykład za tysiąc lat, albo chociaż za sto, będą w stanie te dane odczytać.

Jeśli sądzić po dotychczasowych działaniach, to pewnie nie.

Może jednak będą. Należy się o to zatroszczyć już teraz.

Na razie w Polsce chyba nikt się o to nie troszczy.

Rzeczywiście mamy z tym problem. Chodzi głównie o rodzaj oprogramowania. Musimy być przygotowani na kłopoty, jeśli korzystamy z oprogramowania zamkniętego, takiego jak np. Microsoft Word. Został tak zrobiony, by stworzone w nim dokumenty czytał tylko ten jeden program, gdyż producent nie ujawnia rozwiązań technicznych, jakie w nim zastosowano. Gdy jesteśmy zależni od jednej firmy i ona upadnie, komputery, które potrafią nasze archiwa odczytać, mogą przestać istnieć. Lepiej więc zapisywać dane w pełni jawnych formatach otwartych, jak np. Open Document Format stosowany m.in. przez Open Office.

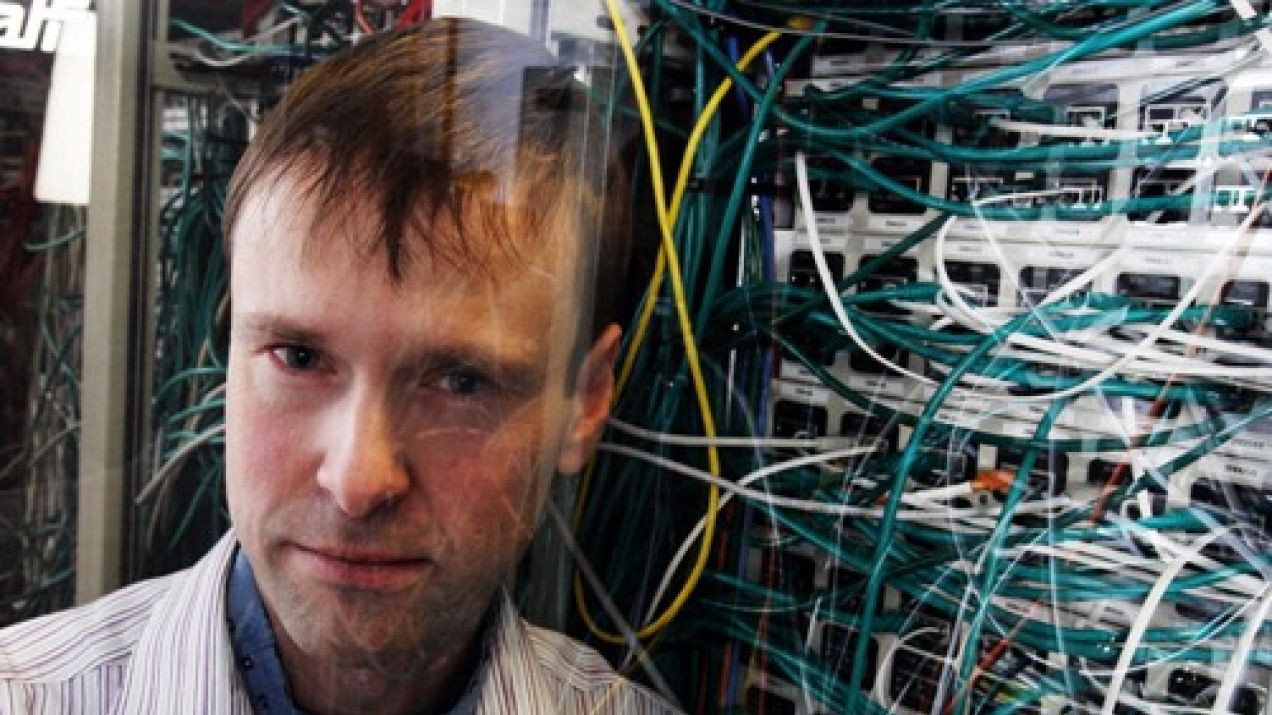

Na świecie powstają ogromne serwerownie. apple właśnie otwiera taką, która ma 4,5 ha, i planuje kolejną. czy u nas są instytucje, np. Biblioteka narodowa, które przechowują dane na masową skalę?

Farmy serwerów, jakie tworzą Apple czy Google, są tak duże, bo stworzono je też do przetwarzania danych. Biblioteka Narodowa, choć pracują w niej informatycy wysokiej klasy, nie ma jeszcze wszystkich swoich zasobów zapisanych w postaci cyfrowej. Ciągle brakuje pieniędzy na porządny system archiwizacji. Nie dorobiliśmy się też narodowego archiwum wieczystego.

Polskie narodowe archiwum cyfrowe (nac) chwali się, że ma 15 mln zdjęć, 30 tys. nagrań dźwiękowych, 2 tys. filmów...

Hm. Narodowe Archiwum Cyfrowe rzeczywiście ma bodajże największy w Polsce zasób materiałów audiowizualnych, tyle tylko, że mało kto o tej instytucji słyszał. TVP też archiwizuje swe zasoby, choć w powolny i kulawy sposób. W obu instytucjach pojawia się problem sprzedaży dostępu do zasobów. Dla mnie oczywiste jest, że zasoby wytworzone za pieniądze podatnika powinny być dla niego dostępne nieodpłatnie, bo już za to zapłacił.

Właśnie, i tu pojawia się problem praw autorskich.

Obecny, restrykcyjny system jest całkowicie nieskuteczny. Należę do radykałów, którzy twierdzą, że prawo własności intelektualnej jest zupełnie niepotrzebne i nie służy rozwojowi cywilizacyjnemu. Rozwiązania problemu należy jednak szukać gdzieś pomiędzy tymi skrajnymi stanowiskami.

Czy digitalizacja i utrzymanie serwerów są kosztowne?

Często wystarcza skaner lub aparat cyfrowy i wolontariusze, którzy te skany zrobią. No i aplikacje do obróbki zdjęć, wolne oprogramowanie do katalogowania, składowania i wyszukiwania. Wszystkie są dostępne za darmo. Kosztowne mogą być serwery do przechowywania i udostępniania danych. Ale możemy przyjść do biblioteki, która należy do polskiej Federacji Bibliotek Cyfrowych i zapytać, czy przejęliby je do upubliczniania w swoich zasobach. W cyfryzacji najistotniejszy jest czynnik ludzki, zrozumienie konieczności archiwizacji i dobre chęci.

Ludzie ci muszą jeszcze umieć opisać swoje zbiory. Tradycyjne katalogowanie podobno przestało być skuteczne.

W dużej mierze tak, bo komputery potrafią na nasze życzenie odnaleźć na zeskanowanych stronach słowa, których szukamy. Powstało też oprogramowanie, które pozwala znaleźć w plikach dźwiękowych wypowiedziany przez nas wyraz. Jednak system fiszek–słów kluczowych jeszcze długo będzie potrzebny do opisywania muzyki i obrazów. Maszyna sama nie umie stwierdzić, który z utworów jest dziełem Beethovena, albo wykonać polecenia „znajdź w zasobach wszystkie wesołe melodie”. Nie potrafi też na zawołanie wyświetlić obrazków z Johnem Wayne’em na białym koniu. Problem jest na tyle złożony, że informatyków czeka tu przynajmniej kilkadziesiąt lat pracy. Mam nadzieję, że w przyszłości uda się też cyfrowo zapisać zapachy...

Czy komputery będą kiedyś umiały samodzielnie wnioskować na podstawie dostępnych informacji?

Informatycy od lat pracują nad tzw. systemami semantycznymi. Dzięki nim komputer, mając zasób danych, mógłby zauważyć, że pies ma coś wspólnego ze zwierzęciem, ze ssakiem itd. Jest to ciekawa wizja, ale trudna do osiągnięcia. To trochę tak jak ze sztuczną inteligencją. Od 50 lat naukowcy wieszczą, że za ok. 15 lat będzie powszechnie dostępna, ale nadal jej nie ma.

Dlatego potrzebna jest inteligencja bibliotekarza.

Tak, choć jego rola się zmienia. Obecnie zajmuje się nie tyle zbiorami książek, ile kolekcjami wiedzy. Proponowałbym więc bardziej adekwatną nazwę dla tego zawodu: kustosz informacji.

To może lepiej infotekarz?

Wolę zostać przy swoim, nieco staromodnym sformułowaniu.